Esculpiendo la piedra...

Enseguida empezamos

Berenguela de Castilla

R. de Campoamor

F. Chueca

R. Codorníu

Dr. Cortezo

J. Romero de Torres

Urraca I de León

Instrucciones

👉🏼 Aunque puedes usar esta app en tu portátil, seguramente te resulte más cómodo usarla desde el móvil.

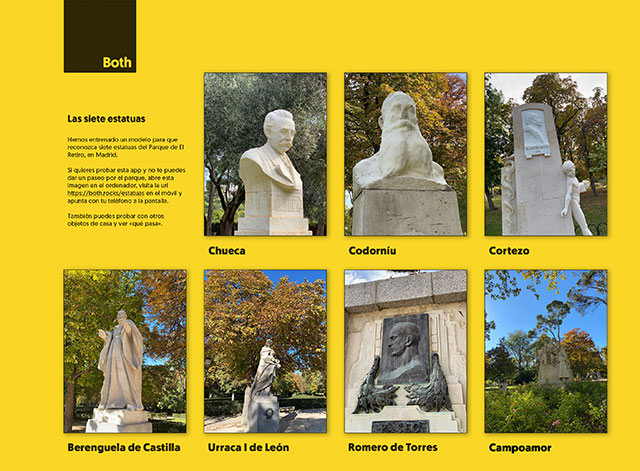

Hemos entrenado un modelo para que reconozca siete estatuas del Parque de El Retiro, en Madrid. Puedes localizar las estatuas en el mapa.

Si quieres usar esta app como debe ser: Date un paseo por el Parque y cuando estés a un par de metros de las estatuas, usa la aplicación para reconocerlas. No hace falta que estés justo enfrente, ni que mantengas el móvil perfectamente vertical. Cuando la red identifique a una estatua con una seguridad superior al 85%, lo indicará.

¿No estás en Madrid, o no te apetece ir al parque? No pasa nada, descárgate nuestro álbum de cromos con las siete estatuas y prueba el proyecto desde casa.

Si quieres usar esta app creativamente: Apunta el móvil a un objeto cualquiera, a un cuadro, a una persona (con su consentimiento, claro). Múevete a su alrededor y mira cómo la red trata desesperadamente de asignarle una categoría. Si encuentras algo curioso, compártelo con nosotros en Twitter.

Motivación

No queremos hacer un reconocedor infalible, queremos explorar las posibilidades de estos sistemas, sus puntos fuertes y sus debilidades.

En este caso, la cámara sustituye a nuestros ojos y nuestra corteza visual: recoge los estímulos, los analiza y los interpreta.

1. Aprender a usar Teachable Machine: Hemos entrenado un modelo con siete categorías, una por estatua. Podéis probar el modelo por vuestra cuenta en Teachable Machine. El dataset está formado por aproximadamente 250 fotos por estatua, sin recortar, tomadas en un día soleado. El modelo está entrenado durante 15 epochs, obteniendo una precisión del 100% en el conjunto de validación.

2. Intentar comprender qué ve el modelo: El mundo del modelo

está formado por siete categorías (las siete estatuas). Ni siquiera

tiene una categoría «esto no es una estatua», por lo que tratará

de asignar cada fotograma a una de esas siete categorías. Pero no

sabemos cómo lo hace: ¿es por algún detalle? ¿por contraste? ¿por

una forma? O más enrevesado aún: ¿podría elegir su respuesta

basándose en el color del cielo, por ejemplo? Si todas las fotos de

Codorníu están tomadas contra un cielo azul, es posible que el

sistema use el fondo como discriminante, en vez de la estatua

propiamente dicha.

Tras probar el modelo, nos quedamos con la sensación de que la categoría correspondiente a Federico Chueca es el «cajón de sastre»: Todo lo que no sea ninguna de las seis otras estatuas es Federico.

3. Reproducir el efecto «Palabra de máquina»: Tendemos a confiar en las instrucciones del GPS, en las indicaciones de las máquinas que nos rodean... sin embargo, estas instrucciones no son siempre precisas ni exactas, como podemos ver en este reconocedor. Al ocultar el stream de vídeo (el botón verde está para algo) quedamos a disposición del modelo: ya no sabemos lo que ve, sino lo que nos dice que ve: su interpretación reducida a siete categorías. Si el modelo nos indica que el estímulo se corresponde con Campoamor al 100% ¿podemos afirmar que realmente la imagen que recoge la cámara es la de Campoamor?